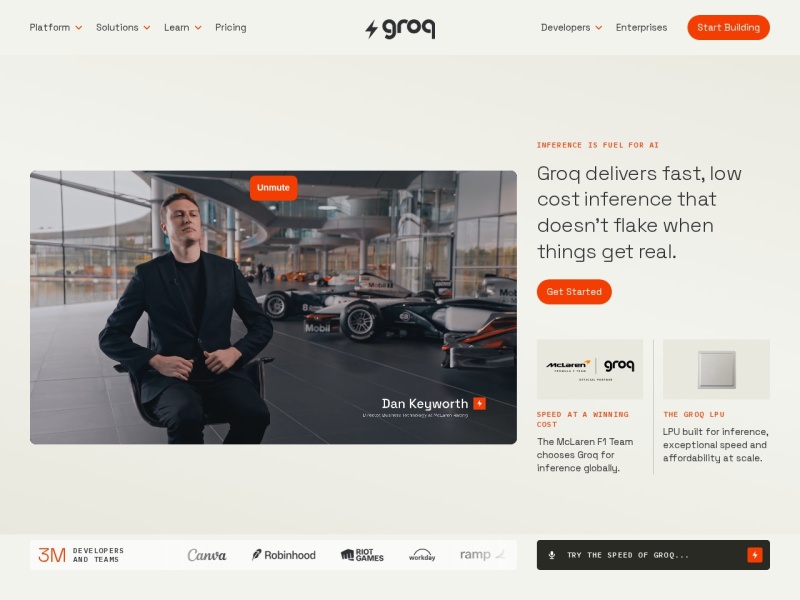

Groq:专为AI推理打造的高速低成本推理平台是一款强大的AI编程辅助工具,利用大语言模型技术为开发者提供智能代码生成、自动调试优化和开发流程自动化等全方位能力,帮助程序员显著提升编码效率和代码质量,是现代软件开发的得力助手。

核心功能

- 智能代码生成:根据自然语言描述或代码注释自动生成完整的函数实现和代码片段,支持Python、JavaScript、TypeScript、Java、Go、Rust等数十种主流编程语言,生成代码符合最佳实践规范

- 代码智能补全:在编码过程中实时预测和补全代码内容,深度理解项目上下文语义和代码结构,提供精准的变量名、函数调用和API使用建议,显著提升编码速度

- 代码审查与优化:AI自动分析代码质量和安全性,发现潜在的Bug、性能瓶颈和安全漏洞,并给出具体的修复建议和优化方案,帮助团队维护高质量的代码库

- 自然语言编程:用中文或英文直接描述想要实现的功能逻辑,AI自动生成可运行的完整代码,大幅降低编程门槛,让非专业开发者也能快速实现自己的想法

- 代码解释与文档生成:据官方介绍,可自动为现有代码添加详细注释和生成API技术文档,帮助团队成员快速理解和维护复杂的代码逻辑

应用场景

日常编码开发:开发者在日常编码中可以利用Groq:专为AI推理打造的高速低成本推理平台快速生成重复性代码、样板代码和工具函数。遇到不熟悉的第三方API或库时,用自然语言描述需求即可获得可用的代码示例和使用指南,大幅减少查阅文档和Stack Overflow的时间。

代码重构优化:技术团队在进行大规模代码重构时,可以利用AI分析现有代码架构,识别可优化的设计模式和重复代码,并生成重构后的代码方案。AI的代码审查能力帮助提前发现潜在问题,降低重构引入新Bug的风险。

快速原型开发:创业团队和独立开发者可以利用Groq:专为AI推理打造的高速低成本推理平台快速搭建产品原型和最小可行产品。用自然语言描述产品功能需求,AI生成核心业务逻辑和界面代码框架,将原型开发时间从数周缩短到数天。

产品亮点

- 多语言全栈支持:覆盖前端、后端、移动端和数据科学等各个开发领域的主流编程语言,无论什么技术栈都能获得有效的AI辅助

- 深度上下文理解:不仅理解当前编辑的代码行,还能分析整个项目的代码结构、依赖关系和设计模式,提供真正符合项目上下文的精准建议

- 学习成本极低:在VS Code、JetBrains等现有IDE中以插件形式运行,开发者无需改变既有的工作习惯和开发流程即可获得AI辅助

- 代码隐私安全:代码数据全程加密传输,据官方介绍不会用于模型训练,满足企业级代码安全和知识产权保护的严格要求

价格与平台

Groq:专为AI推理打造的高速低成本推理平台提供免费基础版,包含核心功能的有限使用额度,适合个人用户和小团队体验使用。付费版本按月或按年订阅,解锁全部高级功能和更大的使用额度。支持Web网页端访问,部分功能据官方介绍也支持iOS和Android移动端使用。注册支持手机号和邮箱登录,新用户通常享有免费体验期。企业用户可根据团队规模和使用需求选择合适的套餐方案,平台提供详细的帮助文档和专属客服支持。

数据统计

相关导航

X-All in one – AI开发平台

大模型实验室 – AI开发平台

Open WebUI — 开源本地大模型管理与对话平台

APIMart – AI开发平台

秒哒 – AI开发平台

Caffe – AI开发平台

Weights & Biases — AI 模型平台领域的专业 AI 工具